Книга: Статистика и котики

Глава 11. Котики счастливые и несчастные или логистическая регрессия и дискриминантный анализ

Глава 11.

Котики счастливые и несчастные

или логистическая регрессия и дискриминантный анализ

Из предыдущей главы вы узнали, как с помощью линейной регрессии понять, насколько сильно те или иные факторы влияют на уровень котикового счастья. Однако, у обычного регрессионного анализа есть одно существенное ограничение — уровень счастья должен быть достаточно точно измерен с помощью какого-нибудь прибора или теста. К сожалению, мы зачастую не располагаем подобным оборудованием. Максимум, что мы можем сделать, это прикинуть, является ли данный конкретный котик счастливым или несчастным.

Можем ли мы при таких условиях найти факторы, предсказывающие котиковое счастье?

Разумеется да. И для этого существуют два очень хороших метода. Первый называется логистической регрессией, а второй — дискриминантным анализом.

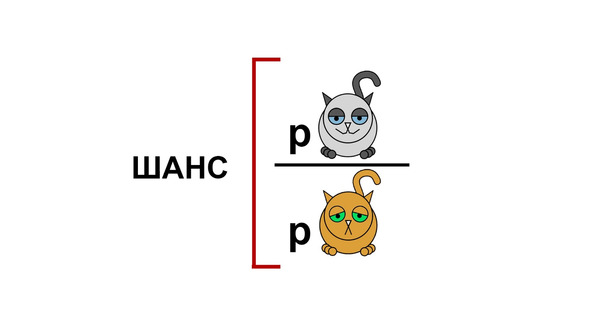

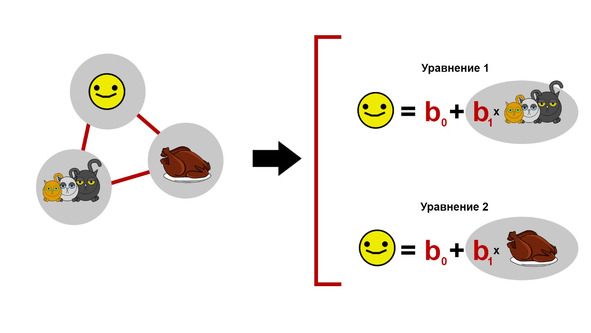

Логистическая регрессия во многом похожа на линейную. Однако вместо уровня счастья в левой части уравнения стоит величина, которая позволяет рассчитать вероятность того, что данный котик счастлив. Эта величина называется логарифмом шанса.

Слово «шанс» достаточно часто встречается в русском языке, как правило, обозначая то, что ни в коем случае нельзя упустить. Но с точки зрения статистики шанс — это вероятность того, что данный котик счастлив, деленная на вероятность того, что он несчастлив.

По некоторым математическим причинам от шанса берут натуральный логарифм и подставляют эту величину в регрессионное уравнение. Если логарифм шанса будет положительным, то данный котик считается счастливым, а если отрицательным — то несчастным.

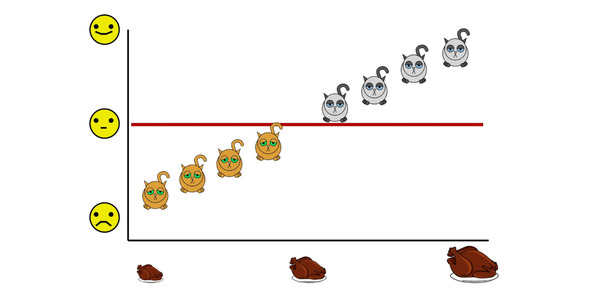

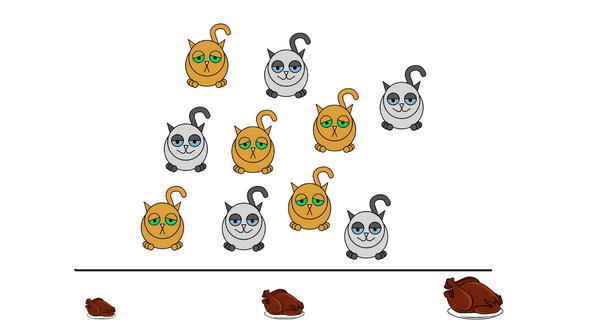

Альтернативным методом является дискриминантный анализ. Чтобы разобраться, что это такое, обратимся к рисунку.

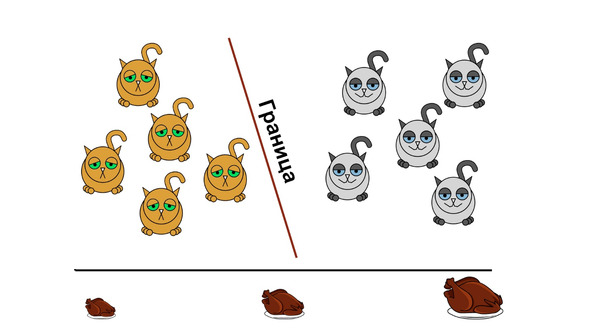

На нем представлены счастливые котики (Барсики) и несчастные (Мурзики), а также информация о том, кто из них сколько ест. Очевидно, что Барсики едят в целом больше, и мы можем провести четкую границу между котиками по этому фактору. И если такая граница возможна, то мы делаем вывод, что фактор связан с уровнем счастья. Иной случай выглядит так.

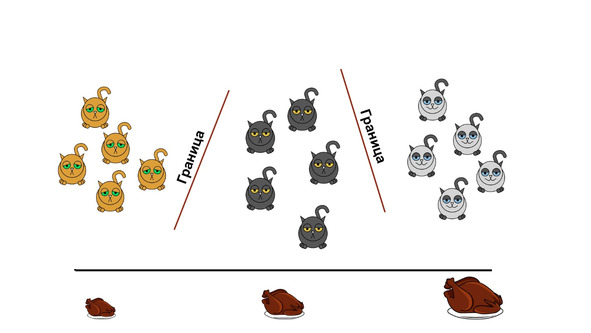

Здесь невозможно построить такую границу, чтобы Барсики оказались по одну ее сторону, а Мурзики — по другую. Соответственно, в этом случае количество еды не связано с уровнем счастья.

Алгоритм нахождения таких границ и называется дискриминантным анализом, а формула, которая задает границы, — дискриминантной функцией. По итогу дискриминантного анализа вы получаете таблицу, в которой обозначается, по каким факторам удалось провести внятные границы, а по каким — нет.

Дискриминантный анализ может работать и с большим количеством групп. Например, если мы добавим к нашим Барсикам и Мурзикам группу философских котиков, дискриминантный анализ сможет найти границы между ними всеми. Число таких границ всегда будет на одну меньше, чем количество групп.

Если же вы являетесь поклонником регрессионного анализа, то при большом количестве групп вы можете вычислить так называемую мультиномиальную регрессию.

НЕМАЛОВАЖНО ЗНАТЬ!

Мультиколлиниарность и переобучение

С методами регрессионного и дискриминантного анализов связаны две проблемы, которые существенным образом могут испортить вам все ваши выводы.

Первая из них — проблемамультиколлиниарности — возникает в случаях, когда некоторые факторы сильно коррелируют между собой, и приводит к неустойчивости получившегося уравнения. Проявляется это в двух формах.

1. При добавлении всего одного-двух котиков в выборку это уравнение может измениться до неузнаваемости.

2. Формулы, построенные на двух сходных выборках котиков, будут различаться.

Как правило, эту проблему преодолевают тремя способами.

1. Исключают одну из коррелирующих переменных из анализа.

2. Предварительно проводят процедуру факторного анализа (о нем будет рассказано далее), заменяющего эти переменные одной искусственной, которая и будет включена в регрессию.

3. Проводят процедуру пошаговой регрессии. Такая регрессия постепенно включает в уравнение по одной переменной и сразу же после этого пересчитывает вклад всех остальных. В итоге если одна из коррелирующих переменных была выбрана в качестве фактора, вторая туда скорее всего не попадет.

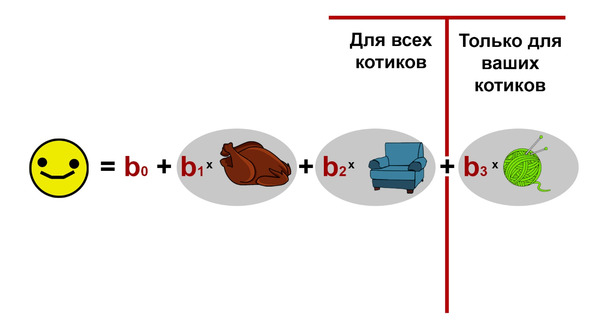

Вторая проблема — проблемапереобучения — заключается в том, что уравнение, полученное на одних котиках, может не работать на других. Она возникает из-за того, что в вашей выборке котиков могут быть закономерности, которые нехарактерны для котиков в целом. И зачастую они попадают в регрессионную модель.

Для того чтобы предотвратить переобучение, используют критерий, который искусственно ограничивает количество факторов, включенных в уравнение (например критерий Акаике и Байесовский информационный критерий).

- Предисловие

- Глава 1. Как выглядят котики или основы описательной статистики

- Глава 2. Картинки с котиками или средства визуализации данных

- Глава 3. Чем отличаются котики от песиков или меры различий для несвязанных выборок

- Глава 4. Как понять, что песики отличаются от котиков или p-уровень значимости

- Глава 5. Котики, песики, слоники или основы дисперсионного анализа

- Глава 6. Диета для котиков или многофакторный дисперсионный анализ

- Глава 7. Что делать, если котик заболел или критерии различий для связанных выборок

- Глава 8. Лечение котиков или дисперсионный анализ с повторными измерениями

- Глава 9. Как сделать котика счастливым или основы корреляционного анализа

- Глава 10. Формула счастья или основы регрессионного анализа

- Глава 11. Котики счастливые и несчастные или логистическая регрессия и дискриминантный анализ

- Глава 12. Котиковые аналоги или основы математического моделирования

- Глава 13. Разновидности котиков или основы кластерного анализа

- Глава 14. О котиковом характере или основы факторного анализа

- Заключение

- Приложение 1. Коротко о главном

- Приложение 2. Работа в статистических пакетах

- Приложение 3. Что еще посмотреть?

- Благодарности

- Содержание книги

- Популярные страницы

- Глава 11. Котики счастливые и несчастные или логистическая регрессия и дискриминантный анализ

- Статистика и котики

- 2.5. Разработка технического задания на проведение детального анализа рынка при работе над инновационным проектом. Основ...

- 9.1. Проблема синтаксического анализа

- 2.12.2. Анализ усилительных каскадов в области малых времен

- Глава 5. Разработка и анализ бизнес-планов в системе Project Expert

- 4.4.3.3. План-фактный анализ продаж

- Кросс-категориальный анализ

- Приложение Глава 33. ABC-анализ

- Анализ CIL-кода

- Анализ роста продаж в связи с промоакциями

- Ситуационный анализ